ZHCY167A July 2016 – July 2020 TDA2E , TDA2EG-17 , TDA2HF , TDA2HG , TDA2HV , TDA2LF , TDA2P-ABZ , TDA2P-ACD , TDA2SA , TDA2SG , TDA2SX , TDA3LA , TDA3LX , TDA3MA , TDA3MD , TDA3MV

需要哪种摄像机?

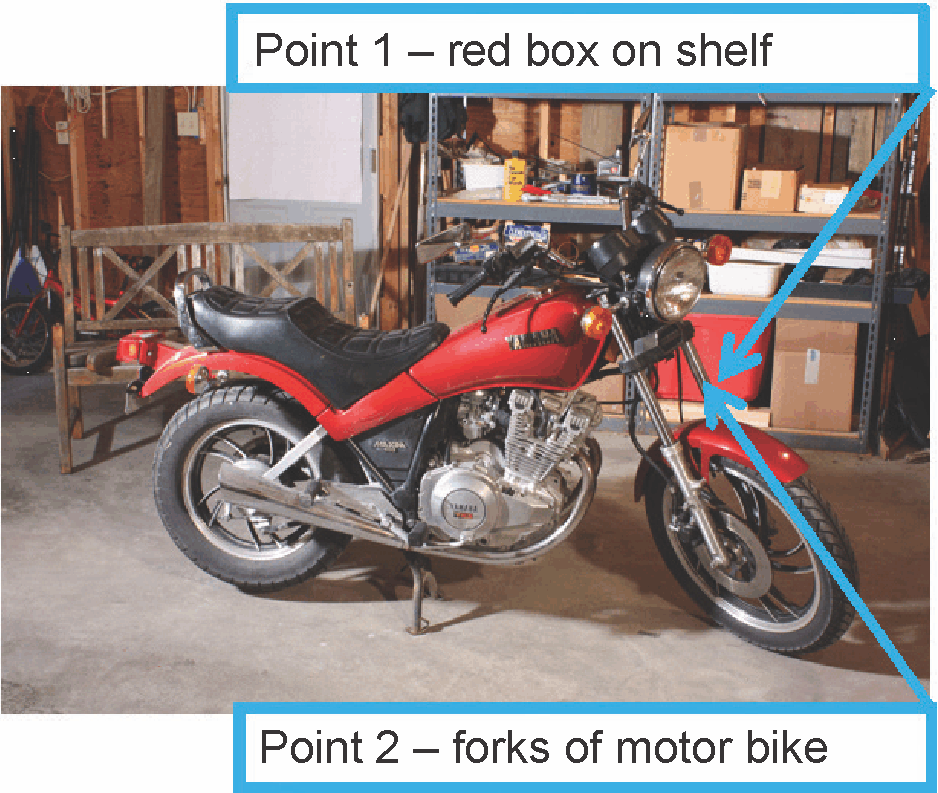

摄像机遇到的所有真实场景都是三维的。现实世界中处于不同深度的物体在摄像机传感器的二维映射世界中可能看起来彼此相邻。图 2 显示了一张来自 Middlebury 图像数据集的图片 [2]。显然,图片前景中的摩托车比背景中的储物架更靠近摄像机(近约两米)。请注意图中标注的第 1 点和第 2 点。在拍摄的图像中,背景中的红色箱子(第 1 点)显示在摩托车前叉(第 2 点)的附近,尽管它至少距离摄像机两米。人脑具有透视功能,让我们能够在 2D 场景的基础上想象出深度。对于汽车中的前置摄像机,透视分析能力并不那么容易实现。

图 2 来自 2014 Middlebury 数据库的图像。尽管所有物体在 2D 映射视图中都相邻,但前景中的摩托车实际上比储物架更靠近摄像机。

图 2 来自 2014 Middlebury 数据库的图像。尽管所有物体在 2D 映射视图中都相邻,但前景中的摩托车实际上比储物架更靠近摄像机。如果我们安装了单个摄像机传感器并将其用于捕获需要处理和分析的视频,该系统称为单眼系统,而两个摄像机彼此分离的系统则称为立体视觉系统。在继续之前,请查看表 1,其中比较了单眼摄像机 ADAS 和立体摄像机系统的基本属性。

| 比较参数 | 单眼摄像机系统 | 立体摄像机系统 |

| 图像传感器、镜头和装配件的数量 | 1 | 2 |

| 系统的物理尺寸 | 小(6 英寸 × 4 英寸 × 1 英寸) | 两个小装配件,间距约为 25–30cm |

| 帧速率 | 30 至 60 帧/秒 | 30 帧/秒 |

| 图像处理要求 | 中 | 高 |

| 检测障碍物和紧急制动决策的可靠性 | 中 | 高 |

| 系统在哪些方面可靠 | 物体检测(车道、行人、交通标志) | 物体检测“和”计算物体距离 |

| 系统成本 | 1× | 1.5× |

| 软件和算法复杂度 | 高 | 中 |

基于单眼摄像机的视频系统可以很好地完成许多工作。该系统及其背后的分析功能能够准确识别车道、行人、大量交通标志以及行驶在道路上的其他车辆。基于从单个摄像机传感器接收到的平面 2D 帧来计算 3D 世界视图时,单眼系统就不那么稳健和可靠了。如果细想我们人类(也就是最高级动物)天生就有两只眼睛的自然事实,这也就不足

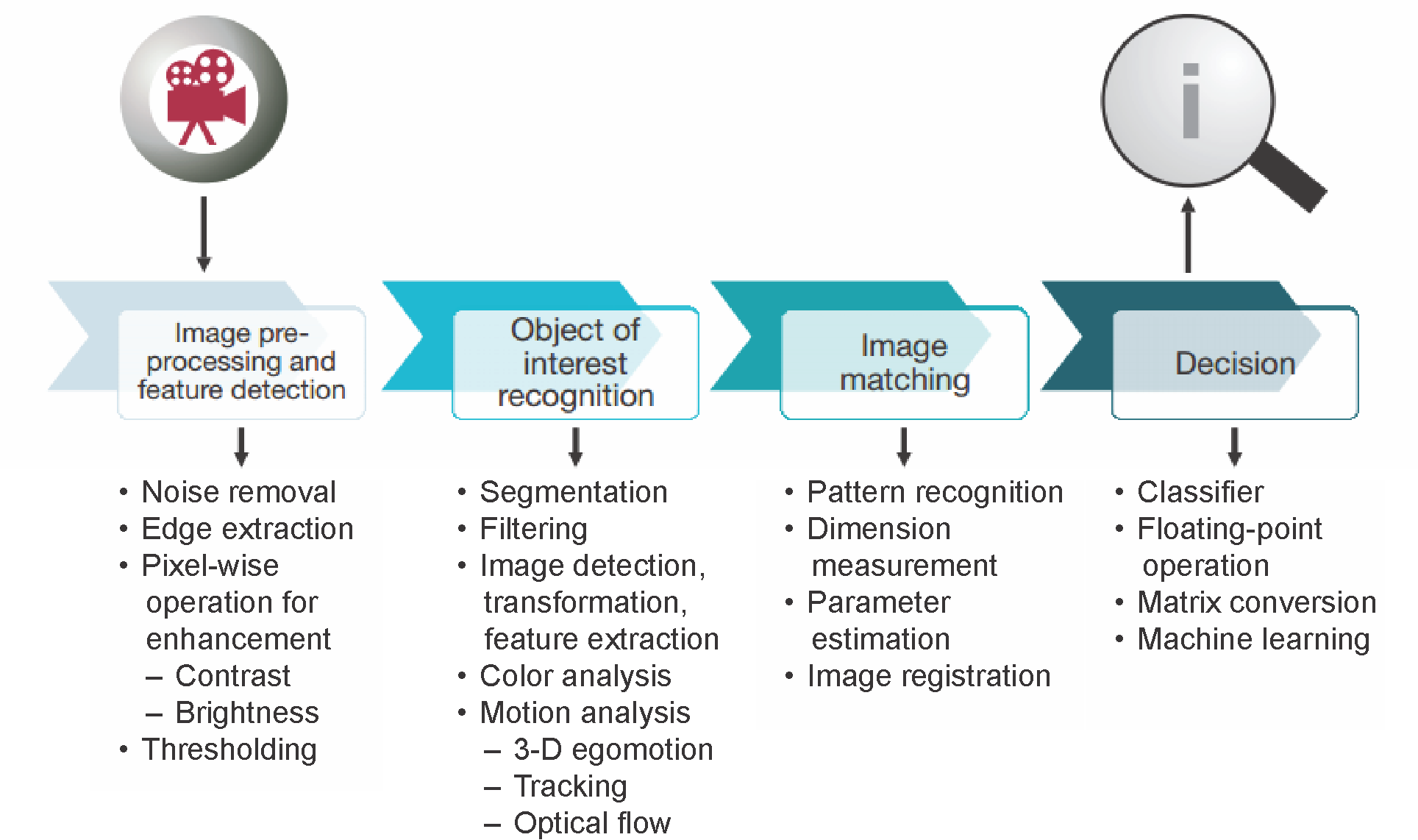

图 3 ADAS 系统中用于分析图像的概要算法流程和过程

图 3 ADAS 系统中用于分析图像的概要算法流程和过程为奇了。在进一步详细分析此问题之前,请查看图 3。此图简要说明了用于分析从摄像机传感器接收到的视频(图像)帧的过程和算法。

图 3 的第一阶段是图像预处理步骤,即针对图像(通常是每个像素)运行各种过滤器,以便去除传感器噪声和其他不需要的信息。此阶段还会将从摄像机传感器接收到的 BAYER 数据的格式转换为 YUV 或 RGB 模式,以便能够在后续步骤进行分析。在第一阶段完成初步特征提取(边缘、Haar、Gabor 滤波器、方向梯度直方图等)的基础上,第二和第三阶段通过运行诸如分割、光流、块匹配和模式识别之类的算法,进一步分析图像以识别出关注区域。最后一个阶段利用从先前阶段生成的区域信息和特征数据,就关注区域中的物体类别做出智能分析决策。这样简短的说明并不能完全解决所涉及 ADAS 图像处理算法领域的问题,但是,本文的主要目的是强调立体视觉系统带来的其他挑战和可靠性,因此块级算法信息足以作为我们深入研究该主题的背景信息。